康奈尔大学建立的免费学术平台arXiv作为全球科学家和技术人员发布早期研究成果的首选枢纽,近日宣布将不再接收计算机科学领域的综述文章或观点论文——除非这些文章已通过期刊或会议的同行评审。这项于10月31日公布的政策调整,源于平台遭遇人工智能生成综述论文的"泛滥",管理员称这些文章"基本只是带注释的参考文献目录"。

AI论文洪流冲击学术平台

arXiv官方声明指出:"过去几年,arXiv被大量论文淹没。生成式AI/大语言模型加剧了这一现象,特别是那些不包含新研究成果的论文,现在可以快速批量生成。"该平台目前每月收到数百篇此类投稿,而历史上由资深研究者撰写的高质量综述仅占极小比例。

arXiv管理员、美国人工智能促进协会前主席Thomas G. Dietterich在社交平台解释道:"大语言模型辅助生成的综述文章激增迫使我们做出这个决定。我们没有足够的审核资源来甄别这些投稿的优劣。"

学术界的AI渗透数据

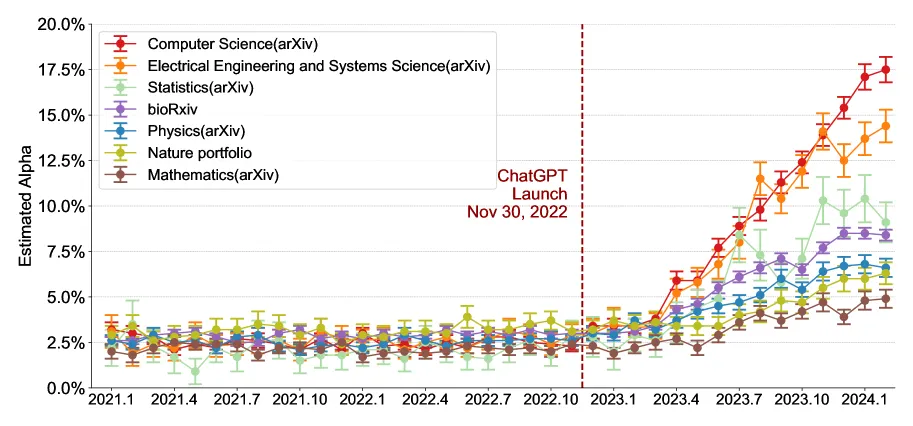

《自然-人类行为》期刊的研究显示,截至2024年9月,近四分之一的计算机科学摘要存在大语言模型修改痕迹。《科学进展》的另项研究表明,自ChatGPT发布以来,2024年研究论文中AI使用量呈爆发式增长。

审核机制面临挑战

arXiv的志愿审核员历来仅根据学术价值和主题相关性筛选投稿,并不进行同行评审。虽然综述和观点论文从未被官方列为正式接收类型,但审核员曾对知名研究者或科学团体的作品网开一面。这种弹性制度在AI生成内容的冲击下已难以为继。

随着生成式AI技术使得肤浅的综述论文唾手可得,该平台近年处理的投稿量激增数倍。

政策引发学界争议

AI安全研究员Stephen Casper担忧新政策可能对早期研究人员及伦理治理领域工作者造成不公影响。他在批评文章中写道:"综述/观点论文的作者多为年轻人、缺乏计算资源者以及来自非传统出版机构的群体。"

部分学者直接批评arXiv的立场错误(甚至愚蠢),也有人支持使用AI来检测AI生成的论文。但现实困境在于:现有AI检测工具误报率居高不下,可能错误标记合法作品;而最新研究显示,科研人员对ChatGPT生成的医学摘要辨识失败率达三分之一。美国癌症研究协会报告称,在强制披露政策下,主动申报AI使用情况的作者不足25%。

新规实施细则

根据新规,作者须提交包含期刊索引号和DOI的同行评审通过证明,研讨会评审将不符合标准。arXiv强调目前仅计算机科学领域实施该政策,但若其他学科出现类似AI投稿激增情况,也可能采取相应措施。

这一变革折射出学术出版界的整体反思。像CVPR 2025等顶级会议已实施政策,直接拒收被标记不负责任的评审人处理的论文。出版商们正艰难应对那些包含明显AI特征的稿件,例如开篇写着"当然,以下是您主题的可能引言"的论文。

资金费率

资金费率 资金费率热力图

资金费率热力图 多空比

多空比 大户多空比

大户多空比 币安/欧易/火币大户多空比

币安/欧易/火币大户多空比 Bitfinex杠杆多空比

Bitfinex杠杆多空比

账号安全

账号安全 资讯收藏

资讯收藏 自选币种

自选币种